今天,分享一篇当前prompt工程太像占卜了,与艺术AI交流就像文字游戏,希望以下当前prompt工程太像占卜了,与艺术AI交流就像文字游戏的内容对您有用。

选自medium

作者:Clive Thompson

机器之心编译编辑:赵阳

「我也不太清楚为什么人们会把 prompt 称为『工程』,我个人更愿意把它称为『占卜』。」

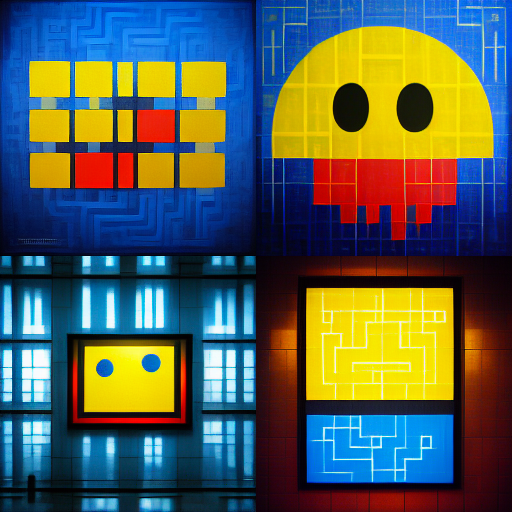

给 AI 绘画工具 Midjourney 输入「吃豆人游戏界面,吃豆人,鬼魂,墨色,眨眼,克莱德,吃豆迷宫,吃豆,蒙德里安风格,现代艺术,现代主义,绽放」后得到的画面。

难道「prompt 工程」的输入短语不有趣吗?

当你向 AI 绘画工具(如 DALL-E 或 Midtravel)输入文本 prompt 以使其生成图片,或者要求自动生成代码的 AI 工具 ——Copilot 编写一些软件时,它们得到的结果可以称得上是艺术品。

我们可以将这一过程称为「工程」,听起来似乎很精确,也很合乎逻辑。但如果你去 Discord 平台上查看人们在 Midjourney 应用中输入的 prompt,你会看到这样的内容:

galaxy arising from a brain, 8k, octane render, micro detailed — upbeta — test — creative

my teeth are yellow, hello world :: would you like me a little better if they were white like yours — s 5000 — q 2 — upbeta — v 3

hg giger lovecraft nightmarish realm where monsters eternally reign terror

chaos corrupted the once valor knight, transforming them into a powerful villian. Horns bursted from their heads, wing and tails grew from their sides, fingers and toes grew into claws. this is what does the void does. this is how life loses….

讲道理编写 prompt 肯定有一种正确的姿势,现实是往往编写起来感觉又无迹可寻,就像是使用魔法咒语的时候,不小心就会把魔咒里的单词放错了地方,很容易就把事情搞砸了。

说得搞笑点,编写 prompt 似乎就像人类试图哄骗「一只急切又困惑的驮运动物」来干活。我们认为它明白我们在说什么,但沟通方式却是大喊大叫,乱跑乱跳。

什么造成了这种现象?

可以说现在是人工智能史上一个非常奇怪的时刻。几十年来,人工智能在图灵测试的「阴影」下不断进步(并非总是如此,但经常如此),图灵测试认为「聪明」人工智能的行为和交流方式与聪明人完全一样。

根据图灵的想法,比如说,如果一个人工生命体能够讨论当前发生的事件,那么它就可以被认为是智能的。近年来,我们将这种清晰、精确、自然的语言期望扩展到日常设备中:与苹果 Siri 和亚马逊 Alexa 交谈,询问天气或设置计时器。

但与产生艺术作品的人工智能「对话」截然不同。我们试图让它们创造一些东西。这意味着,如果人工智能犯了错误,后果要严重得多。没人在乎在线聊天机器人聊天的时候突然掉线。如果聊天机器人不是实时直播 NBA,那就没什么大不了的。

但如果我们有一个特定的创造需求来让人工智能满足呢?如果我们想让它写一篇具有特定内容和风格的博客文章呢?我们当然需要确保我们能够与它正确沟通。

这意味着我们必须开始思考人工智能在想什么,或者更确切地说,它是怎么想的。我们必须进一步发展心理学家所说的机器「心智理论」。「听起来好像天方夜谭,对吧?」正如 OpenAI 联合创始人 Andrej Karpathy 在谈到 Copilot 时告诉笔者的那样。「这不是你过去司空见惯的东西。它不像人类的心智理论。它就像是一个外星人的人工制品,而且是从大规模的优化过程中产生的。」

笔者并不是说这些人工智能实际上是有意识的、智能的或其他什么。它们只是非常微妙的模式识别器和序列完成器,内在更像是一片混乱的数学海洋。

但是,又因为我们是用语言向它们发出命令,这让我们陷入了一种奇怪的心理关系 —— 试图探知里面发生了什么。

笔者想起了古希腊人如何与德尔菲神谕(Delphic oracle)互动。德尔菲神谕被认为能通晓过去、现在和未来。提问后的答案可能很奇怪,因为从本质上讲,这就好像是在和外国人说话一样,谁知道你会得到什么结果?

与艺术 AI 的交流就像一个文字游戏

研究艺术机器人内部工作的科学家们记录了一些这些机器奇怪的内部状态。最近,德克萨斯大学奥斯汀分校的两名研究人员发现,DALL-E 2 生成了明显的乱七八糟的短语,在模型本身中,这些短语似乎具有某种一致的含义。

他们注意到模型生成了短语「Apoploe vesrreitais」,当他们将其作为 prompt 反馈给 DALL-E 2 时,它画出的是鸟类。类似地,接受到「Contarra ccetnxniams luryca tanniounons」后会绘制昆虫或害虫。用「Wa ch zod ahakes rea」会制作出海鲜的图片。

这是为什么呢?模型是如何生成这种奇怪的内部新语言的?科学家们对此一无所知,尽管这看起来像是 DALL-E 2 的文本编码器的对抗性产物。

同样,prompt 编写专家们说,不断重复短语是一种技巧,就像 Michael Taylor 在《Prompt Engineering: From Words to Art》所写的那样。

链接:https://www.saxifrage.xyz/post/prompt-engineering

DALL-E 2、Midtravel 或其他 AI 艺术工具在生成图像时需要真正捕捉到重要特性,此时简单重复的效果出乎意料地好。以这组 prompt 为例:「homer simpson, from the simpsons, eating a donut, homer simpson, homer simpson, homer simpson」

感觉好像是我们需要催眠人工智能,使其专注于我们关心的主题。你也可以在 prompt 编写者通常使用的大量描述性词语中看到这一点。看看 Xe Iaso 结合 stable diffusion 生成的图像:

不得不说画面还是有点诗意的。与艺术 AI 的交流感觉就像一个文字游戏 —— 就像玩 Charades 或 Taboo,你必须通过围绕一个主题进行对话来触发 AI 生成正确的结果。除此之外,我们的目标是找到正确的咒语,唤醒居住在那座由媒介物组成的圣坛中的灵魂,并召唤它们听从你的命令。

正如 Xe 所说的,「我也不太清楚为什么人们会把 prompt 称为『工程』,我个人更愿意把它称为『占卜』。」

也许,我们需要对 prompt 生成模型做一些严谨的澄清。因为它要求我们以一种完全疯狂的方式进行交流,所以它不太像是能满足图灵测试的要求,在智力上并不「像」我们。笔者坚信总有一天艺术 AI 是能像我们的!但现在,它们确实真的很奇怪。

原文地址:https://clivethompson.medium.com/the-psychological-weirdness-of-prompt-engineering-3846755df50c