原标题:用“算法”模拟光束可攻击自动驾驶车辆,专家呼吁重视AI安全 来源:${imgs

【猎云网北京】3月11日报道

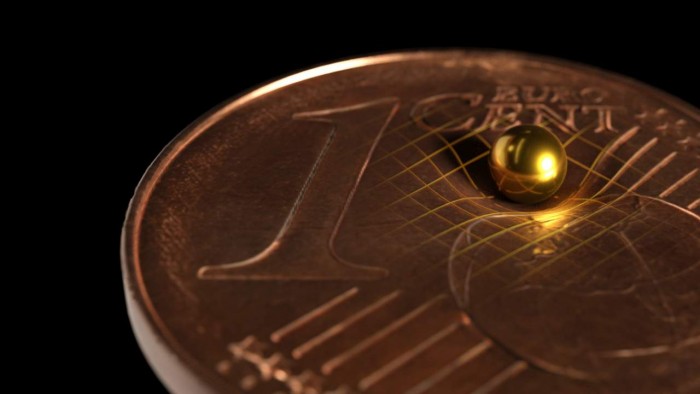

攻击AI有多简单?一束光就够了。

3月11日,阿里安全专家发布了一项新研究,只要用简单的激光笔,就可以让AI模型不再有效。在这个研究中,他们设计了一种算法,可模拟光束对AI模型进行“攻击”,这种测试方法在现实世界中得到了验证,且“攻击”极易操作,对现有基于AI的视觉系统更具威胁,例如基于AI视觉的自动驾驶。

当不同频谱的光束打在同一个物体上,AI可能将该物体识别错误,比如将停车标识识别成顺利通行。难以想象,假如一个人正在飞奔的自动驾驶汽车上闭眼休息,AI将“前有危险”识别成“通行”后直接坠入万丈悬崖;或者直接无法识别前方行人,对于行人而言将有多么危险。

一束激光可能让自动驾驶汽车对交通标识识别错误

“攻击AI远非需要人为去制造对抗样本,一支简单的激光笔就可以。我们想通过这个研究揭示AI模型一些之前没有被探索过的‘错误’,从而‘强壮’AI,让它未来能抵挡这种‘攻击’,也让相关从业者重视提高AI模型的安全性。”阿里安全图灵实验室负责人薛晖说道。

除了以“一束光”测试AI视觉的安全性,最近图灵实验室发布了多项涉及AI安全的研究成果,比如多项文字识别与检测、利用自监督建立视频表征学习方法与提升半监督行为检测的算法框架、AI样本对抗、伪造人脸检测、AI对人脸与人声匹配的双重模态识别、视频描述AI生成技术等囊括AI“视觉”“听觉”“大脑”“免疫性”等多方研究,这10项涉及AI安全的新一代安全架构研究成果均被国际顶会CVPR2021收录。

“在AI安全前沿技术上进行探索,一是为了让AI更安全,二是为了让AI助力安全,三是为解决具体社会问题寻找提效的新途径。”薛晖说。

互联网内容越来越朝着视频化的方向发展,每天用户上传和浏览的数量也在不断增长,视频中所可能存在的内容风险,如色情、恐怖、暴力等信息也对内容安全造成威胁,安全技术人员有必要通过机器来对视频内容进行理解。

因此,阿里安全高级算法工程师陈达与阿里安全实习算法工程师邓超睿一起开展了自顶向下的密集型视频描述生成研究,通过算法对给定视频自动生成对视频内容进行描述的一段文字,提前过滤不良内容,守护互联网清朗健康环境。

书乐是阿里安全图灵实验室的一名女性算法专家,她认为算法应该是有“温度”“柔软”的,希望能在保护大众隐私的基础上,更加高效地解决机场、火车站、车库、游乐场等环境下走失儿童、老人的寻找问题。

以往行人重识别模型在实际部署中,面临着训练数据的采集场景与模型部署场景存在差异的问题,比如模型地训练场景是机场,但在火车站可能不好用,模型精度会降低。因此,书乐的研究集中在提升AI模型的泛化能力上,以适用于不同的部署场景,且不用识别人脸,通过衣着、步态等,即可提升找寻效率。

高级算法专家越丰十分关注AI对抗样本的问题,高质量的DeepFake人脸伪造视频更容易被制作并引发不良影响,而真实场景的伪造视频数据分布和视频质量参差不齐,他们正在通过寻找一个更鲁棒的方法提升检测AI检测算法的实用性。

“安全部署要前置,无论是AI本身的安全,还是AI可以助力解决的安全问题与社会问题,这就是从源头构筑安全的核心理念。”薛晖表示,希望在广阔的AI安全研究的新领域中,能有更多新生力量加入,迸发出有创造性和想象力的研究,最终应用到人们的生活中,真正服务大众,解决难题。