人工智能商业时代即将来临。新冠大流行加速了许多公司对快速数字化和利用人工智能增强其业务流程的需求。但是,新技术也带来了新的责任。

这项针对100位C级数据和分析高管的全球调查揭示了专注于人工智能的高管们正在考虑和解决的复杂问题,以帮助他们的组织能够以道德的方式实现人工智能。

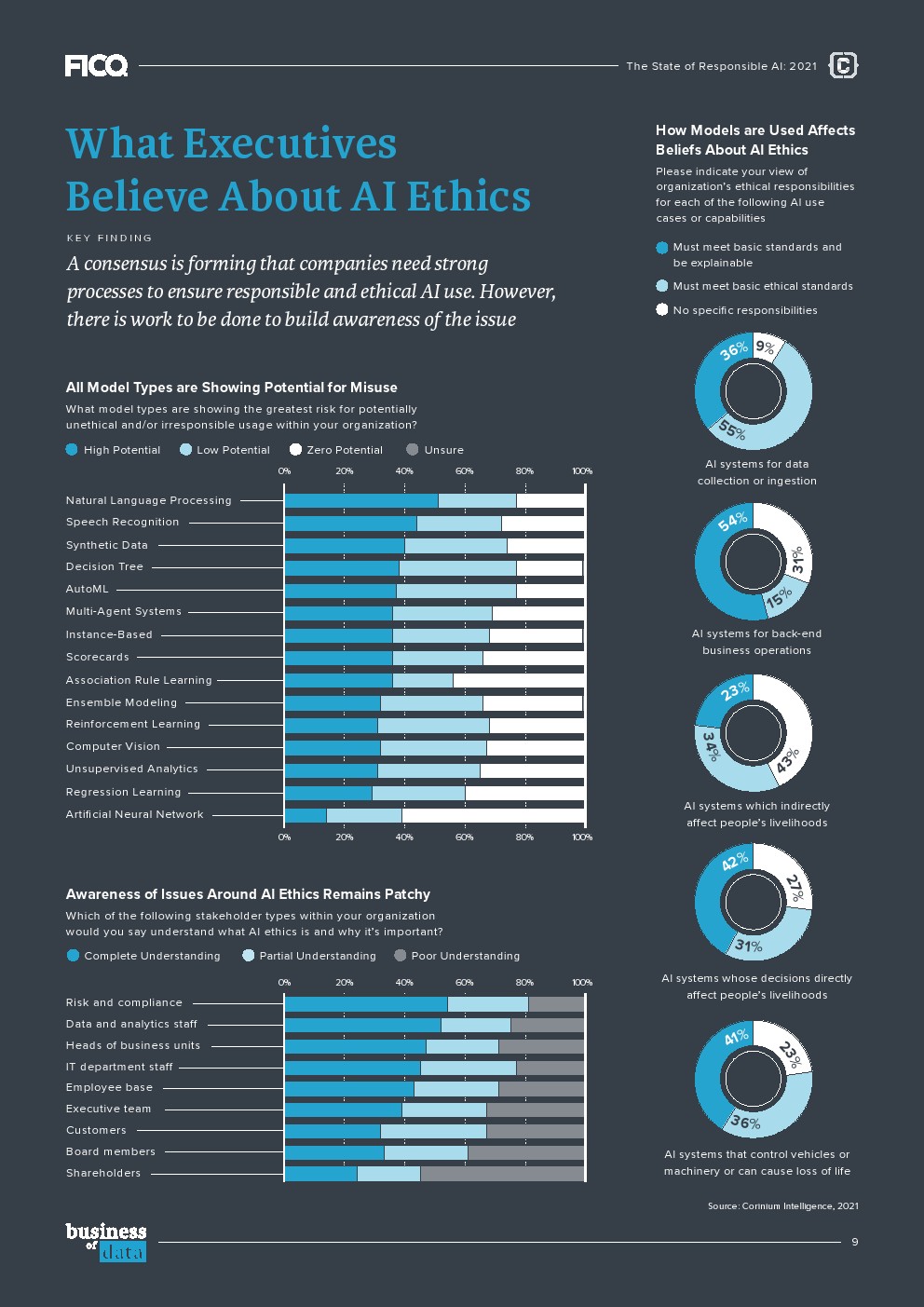

调查发现强调了人工智能道德问题的真实程度。专注于人工智能的高管们可能会更加关注人工智能道德方面的问题。但对于企业在使用人工智能时所应承担的责任方面,目前还没有达成共识。

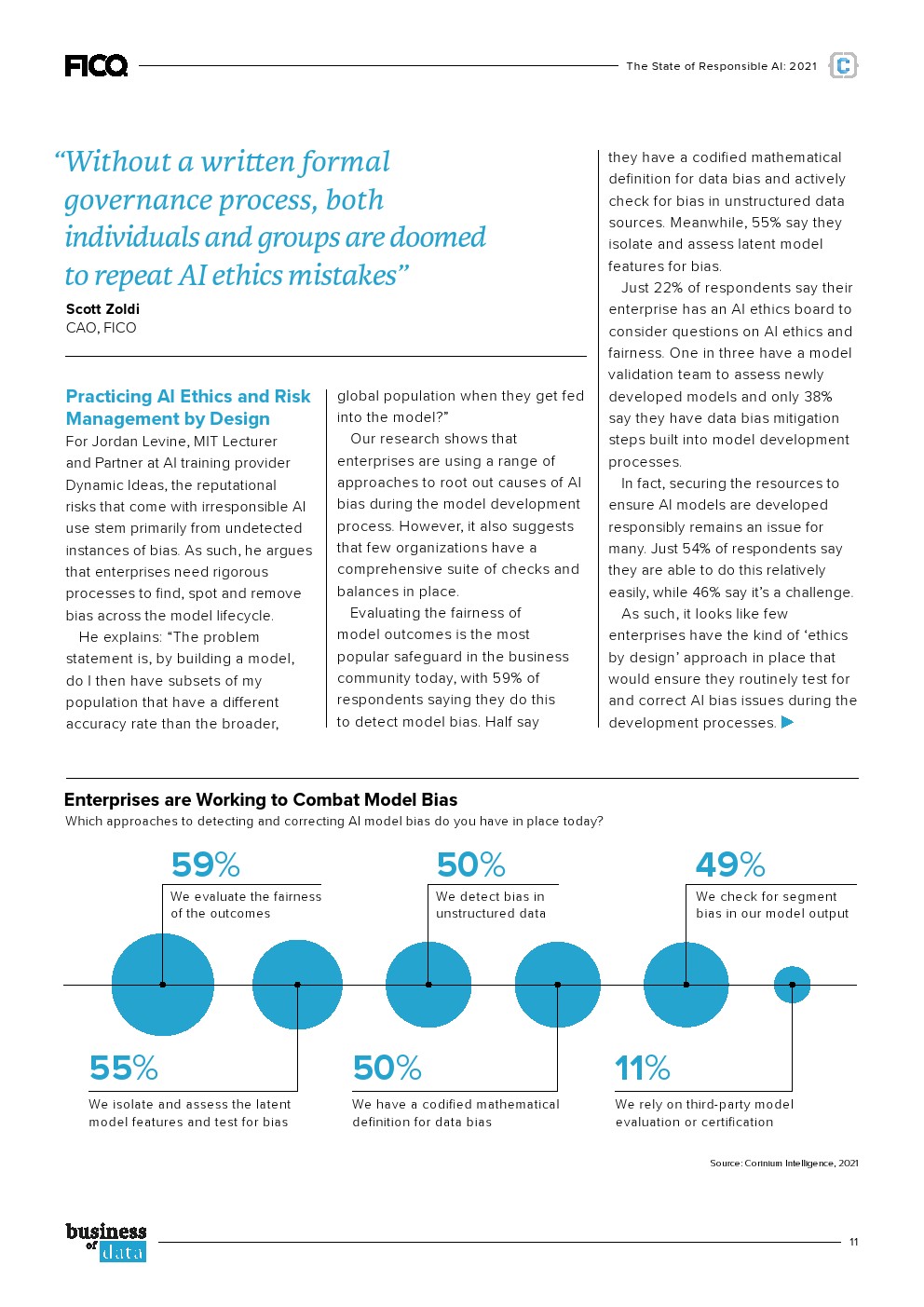

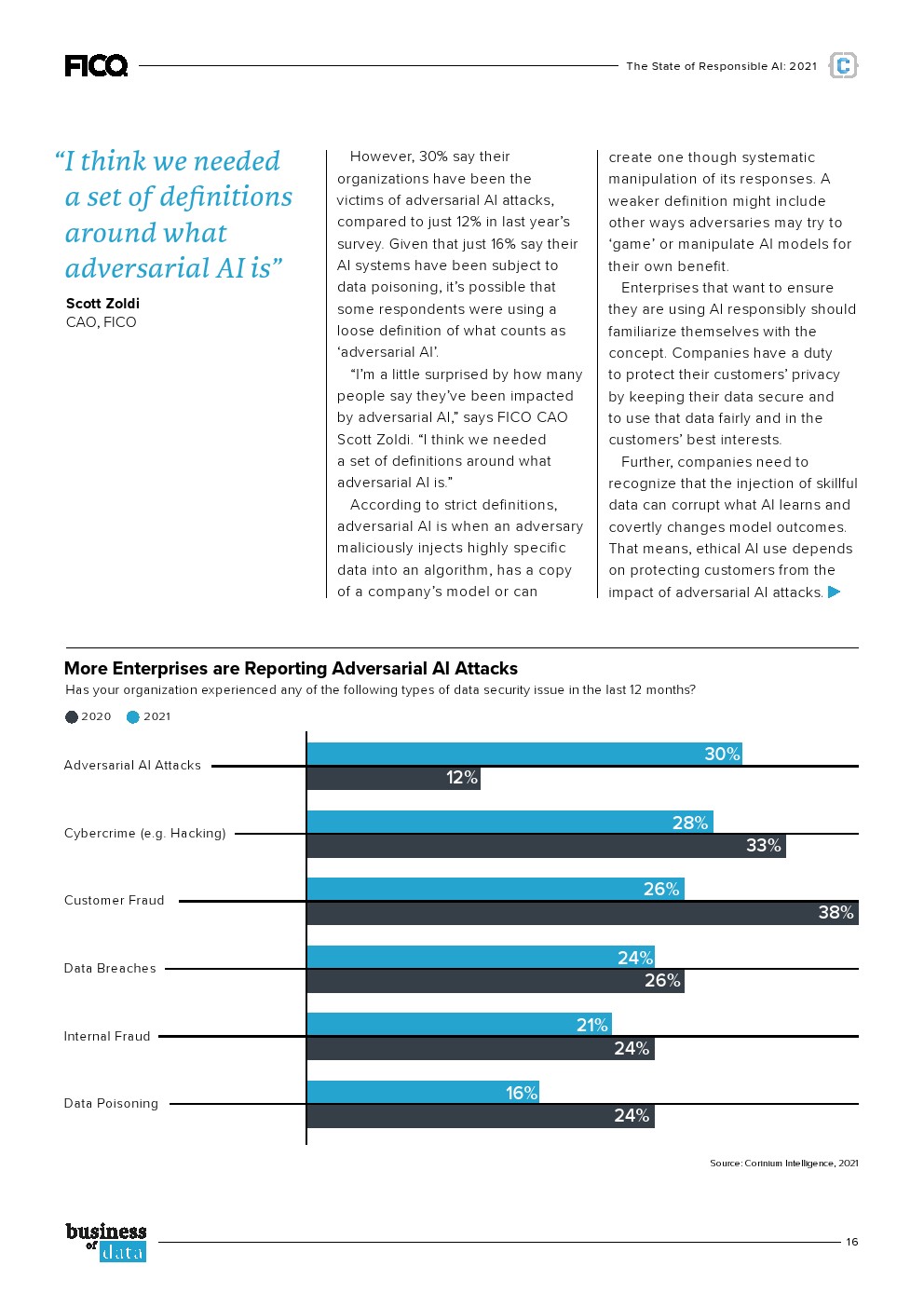

报告还探讨了企业在开发过程中如何有效地克服人工智能模型偏差。

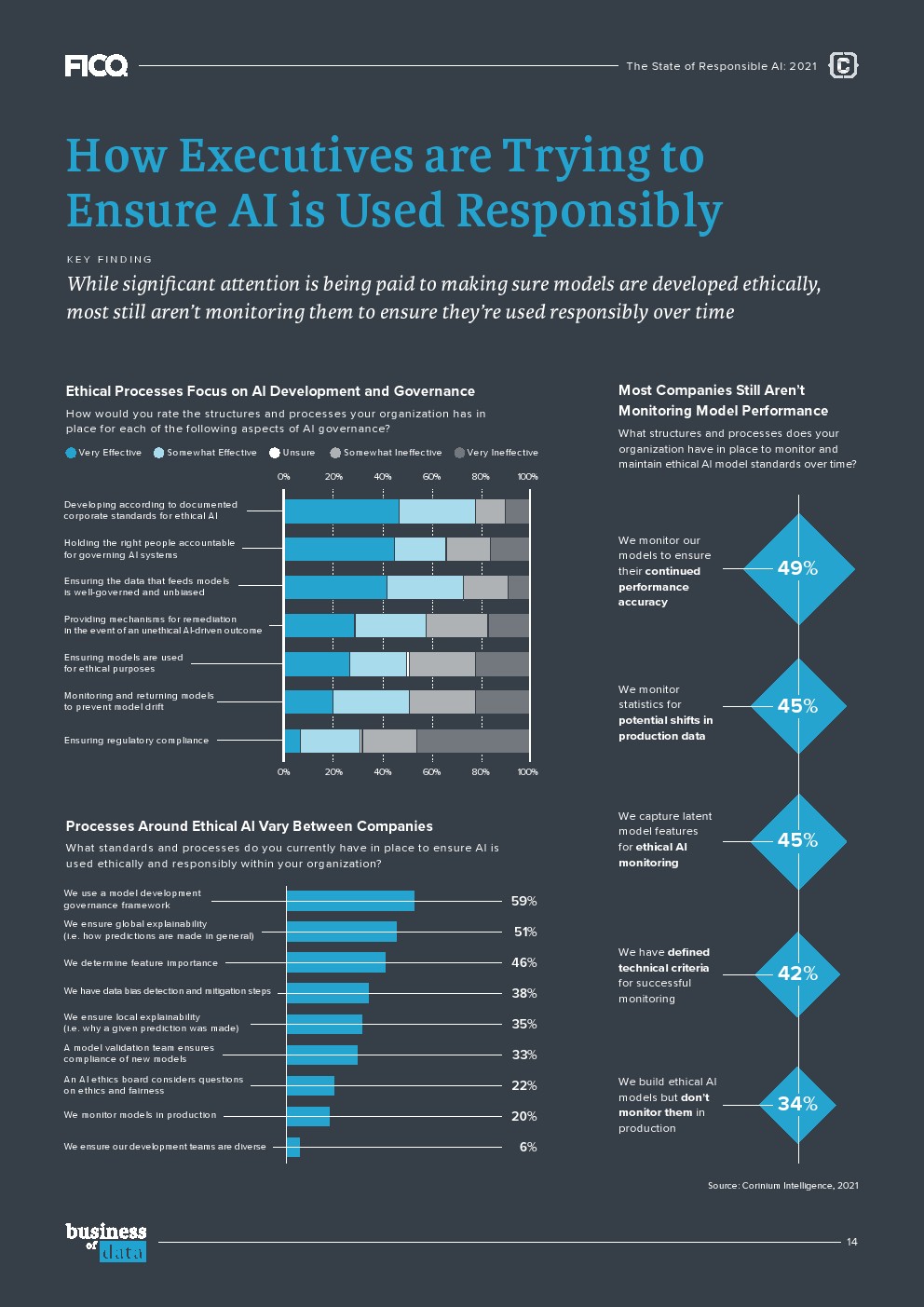

很少有企业有这样的“设计伦理”方法,可以确保他们纠正人工智能定期测试中的偏差。

报告建议那些希望确保企业负责任地使用人工智能的高管们:

了解与人工智能相关的风险开发更好的实践以确保合规性更加重视持续的模型监控和维护主要发现:

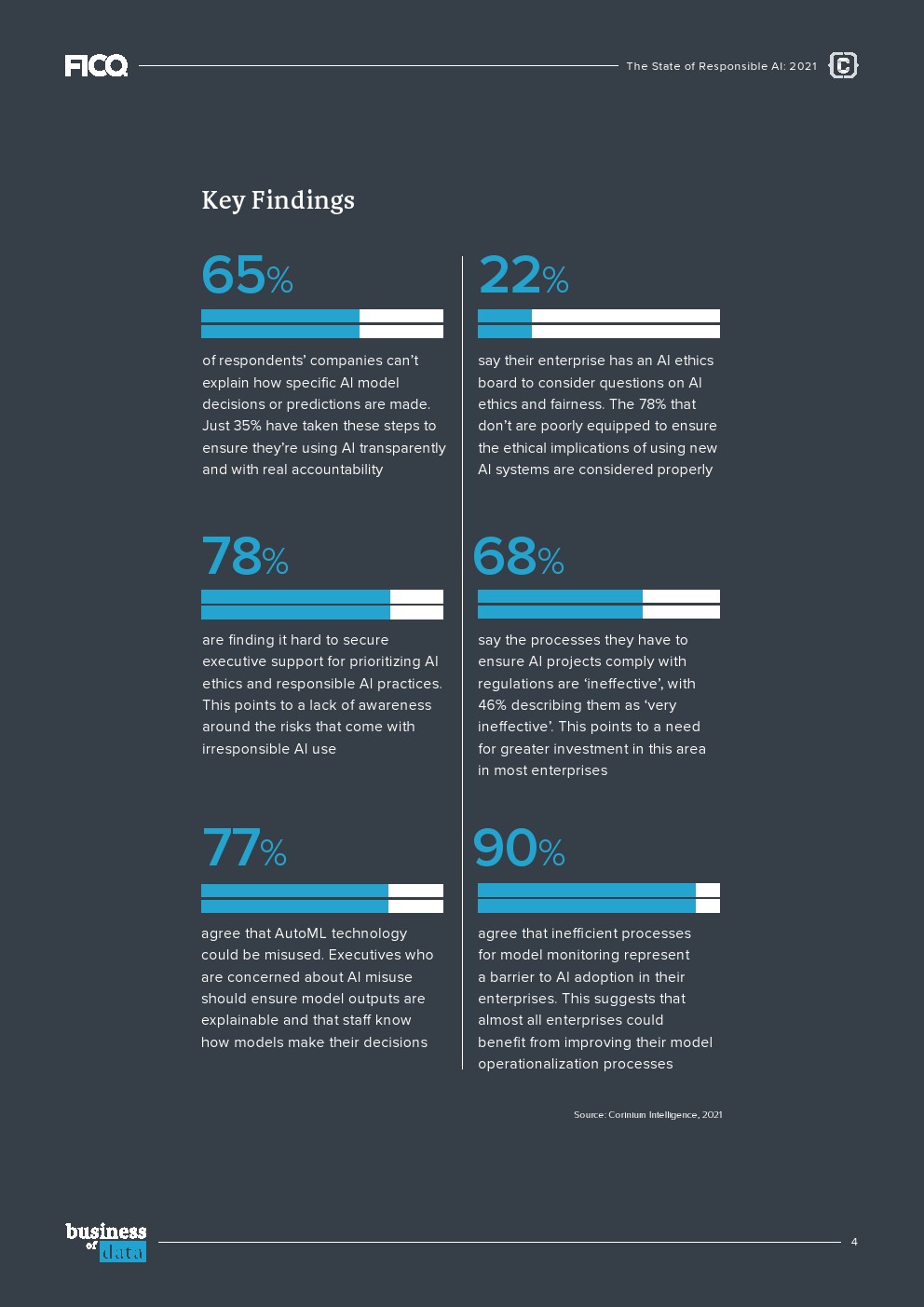

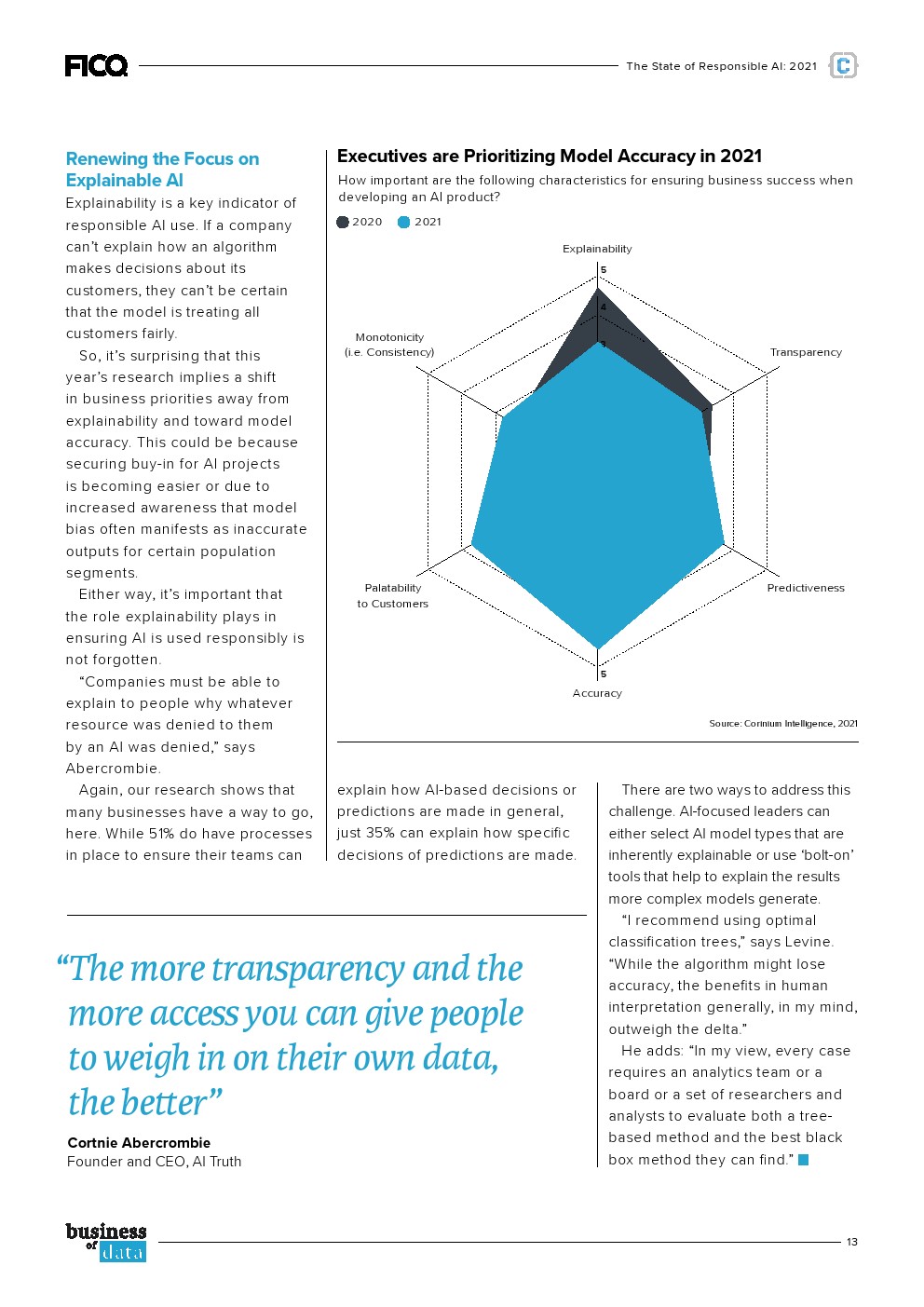

65%的公司无法解释具体的 AI 模型决策或预测是如何实现的。只有 35% 的受访者以透明的方式使用AI并真正负起责任。

22% 的受访者表示,他们的企业设有 AI 道德委员会。78% 的企业无法确保正确考虑使用新 AI 系统的道德影响

78% 的受访者发现优先考虑负责人的AI实践很难获得高管的支持。这表明对不负责任的AI使用所带来的风险缺乏认识。

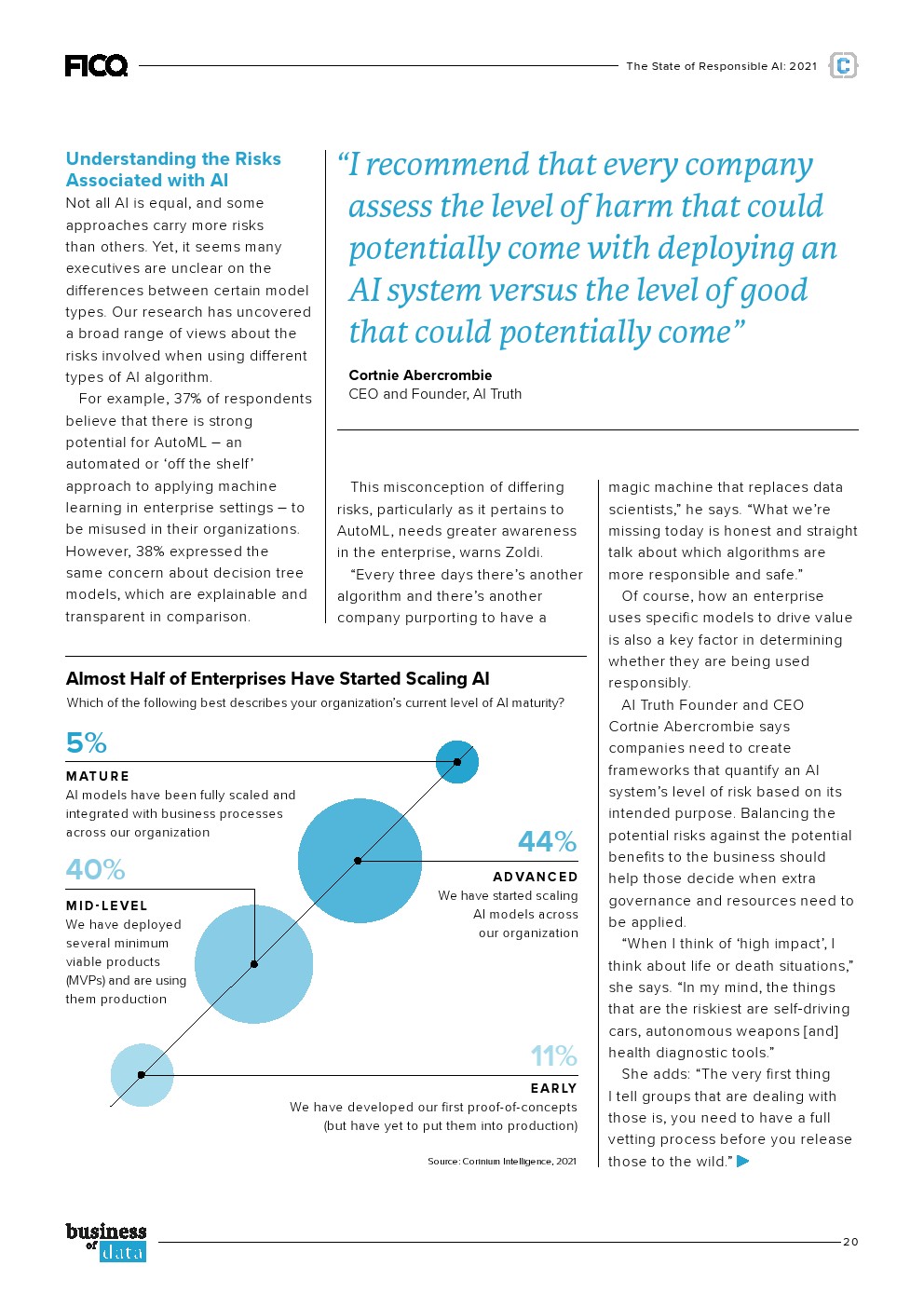

77% 的受访者认为 AutoML 技术可能会被滥用。

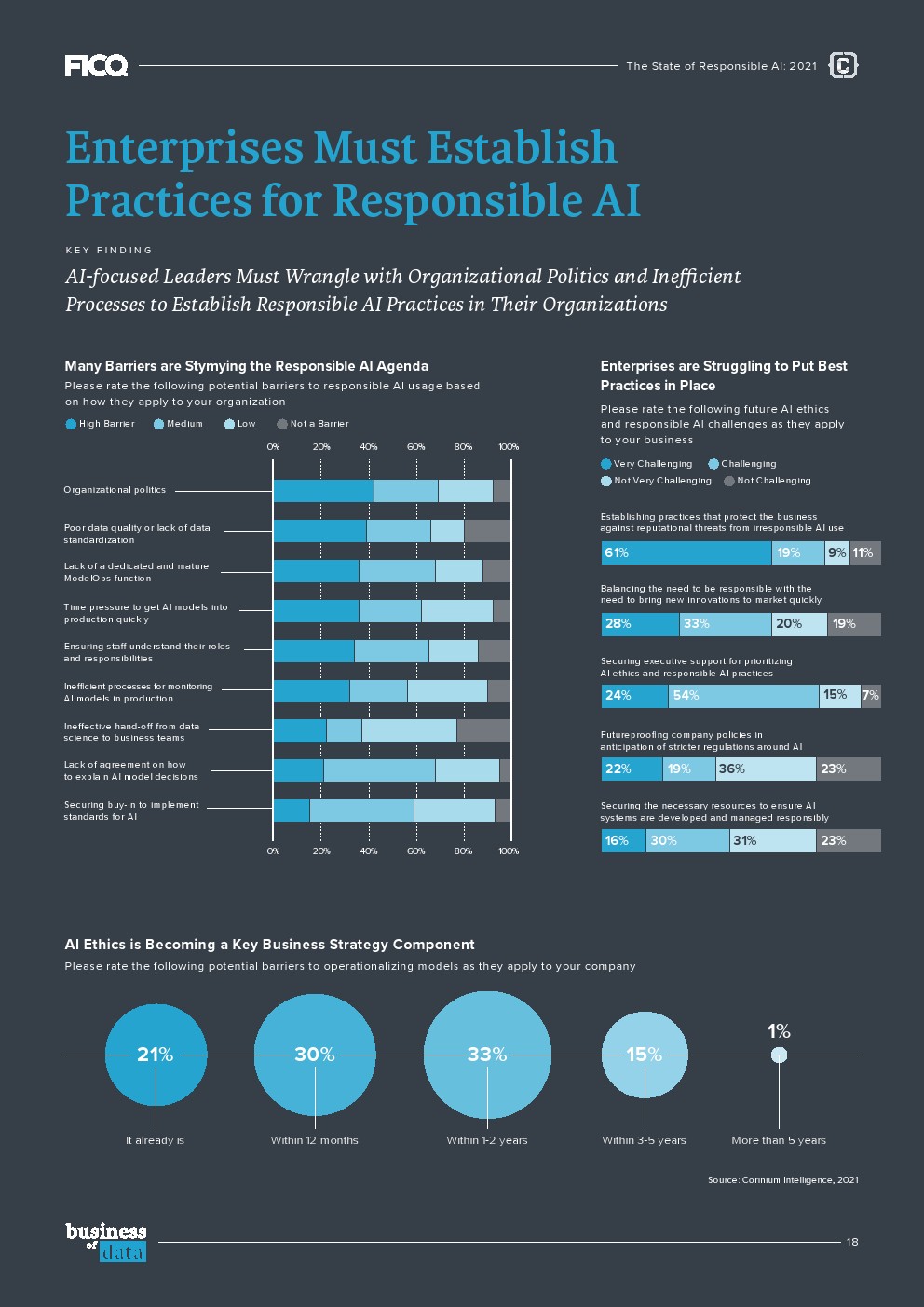

90% 的高管同意模型监控的低效流程是其企业采用 AI 的障碍。