今天,分享一篇无需新型token mixer就能SOTAMetaFormer视觉基线模型开源,刷新ImageNet记录,希望以下无需新型token mixer就能SOTAMetaFormer视觉基线模型开源,刷新ImageNet记录的内容对您有用。

来自新加坡国立大学和 Sea AI Lab 的研究者开源了四种 MetaFormer 基线模型,通过使用最基本或者最常见的 token mixer,探索了 MetaFormer 的下限、通用性和潜力。值得注意的是,所提模型之一 CAFormer 基于 ImageNet 常规有监督训练(无额外数据和蒸馏),在 224x224 分辨率上取得 85.5% 的新纪录,相比之前的 SOTA 模型减少了 55% 的参数量和 45% 的计算量。此外,该团队所提出的激活函数StarReLU比常用的GELU减少了71%的计算量,但取得了更好的性能。

论文地址:https://arxiv.org/abs/2210.13452

代码地址:https://github.com/sail-sg/metaformer

*This work was partially performed when W. Yu was a research intern at Sea AI Lab.

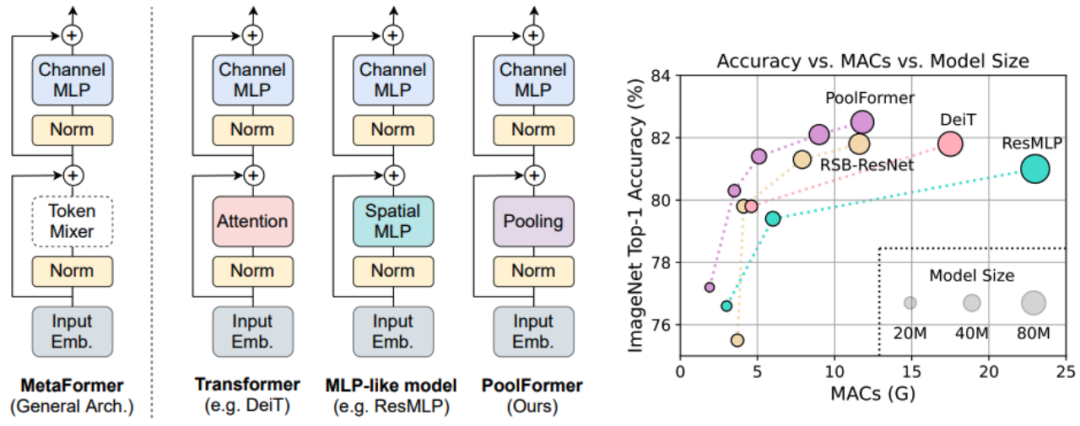

去年,该团队的一篇论文《MetaFormer Is Actually What You Need for Vision》引起研究社区关注。该论文针对 Transformer 模型 “Attention is all you need” 的观点提出了不同看法,即 MetaForemr 猜想 “MetaFormer Is Actually What You Need”。该论文通过把 attention 模块抽象成 token mixer,从而将 Transformer 抽象成通用架构 MetaFormer。为了验证 MetaFormer 猜想,作者把 token mixer 设置为极为简单的池化算子,发现所得模型 PoolFormer 性能居然超过了 ViT/MIL-like/ResNet 等模型,实验结果很好地验证了 MetaFormer 猜想。

图源:该团队去年的论文《MetaFormer Is Actually What You Need for Vision》(CVPR 2022 Oral)

最近,该团队再次进一步探究通用架构 MetaFormer 的各种性质:他们在 MetaFormer 框架下,通过使用最基本或者最常见的 token mixer,引入了几种 MetaFormer 基线模型,并总结了他们的观察。

1.MetaFormer 确保可靠的性能下限。

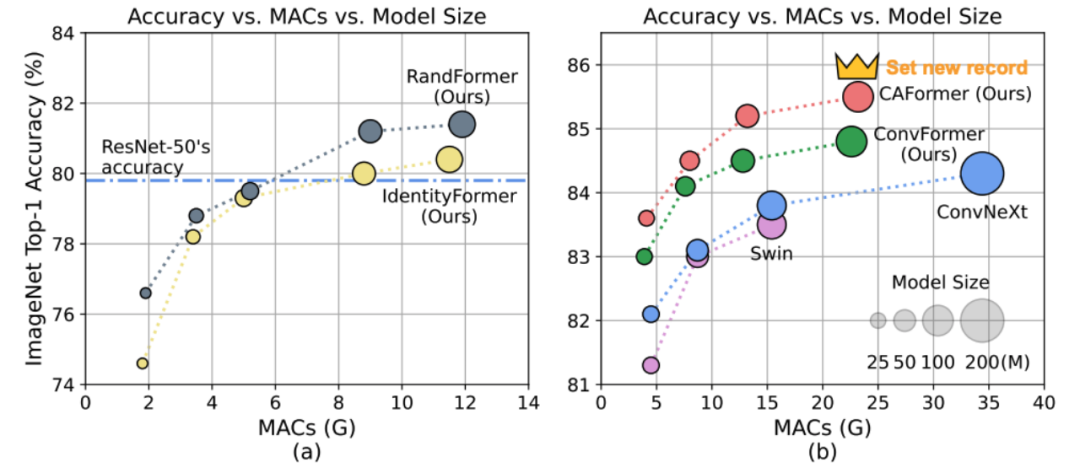

为了探索模型的性能下限,作者将 token mixer 设定为恒等映射。实验发现,这个名为 IdentityFormer 的简陋模型,在 ImageNet 上竟然能取得超过 80% 的准确率。

2. MetaFormer 使用任意 token mixer 也能工作。

为了探索 MetaFormer 对于 token mixer 的通用性,作者使用全局随机矩阵(随机初始化后固定住)来混合 token。具体地,对于四阶段模型,作者将后两阶段的 token mixer 设置为随机混合,而前两阶段的 token mixer 仍然保持为恒等映射,以避免引入过多计算量和固定参数。所派生的 RandFormer 模型被证明是有效的,准确率相比 IdentityFormer 提高了 1.0%,为 81.4%。这一结果证明 MetaFormer 对于 token mixer 有很好的通用性。因此,当引入新奇的 token mixer 时,请放心 MetaFormer 的性能。

图 1:MetaFormer 基线模型和其他最先进模型在 ImageNet 224x224

图 1:MetaFormer 基线模型和其他最先进模型在 ImageNet 224x224分辨率上的性能。该论文所提模型的具体架构展示在后续的图 2 中。(a) IdentityFormer/RandFormer 取得超过 80%/81% 的准确率,表明 MetaFormer 具有可靠的性能下限,并且使用任意 token mixer 都能很好地工作。图中 ResNet-50 的准确率来自论文《ResNet strikes back》。(b) 使用经典可分离卷积做为 token mixer 的 ConvFormer (可视为纯 CNN)大幅优于 ConvNeXt,而使用可分离卷积和原始 self-attention 作为 token mixer 的 CAFormer 在常规有监督训练下(无额外数据和蒸馏),在 ImageNet 224x224 分辨率上创造了 85.5% 准确率的新记录。

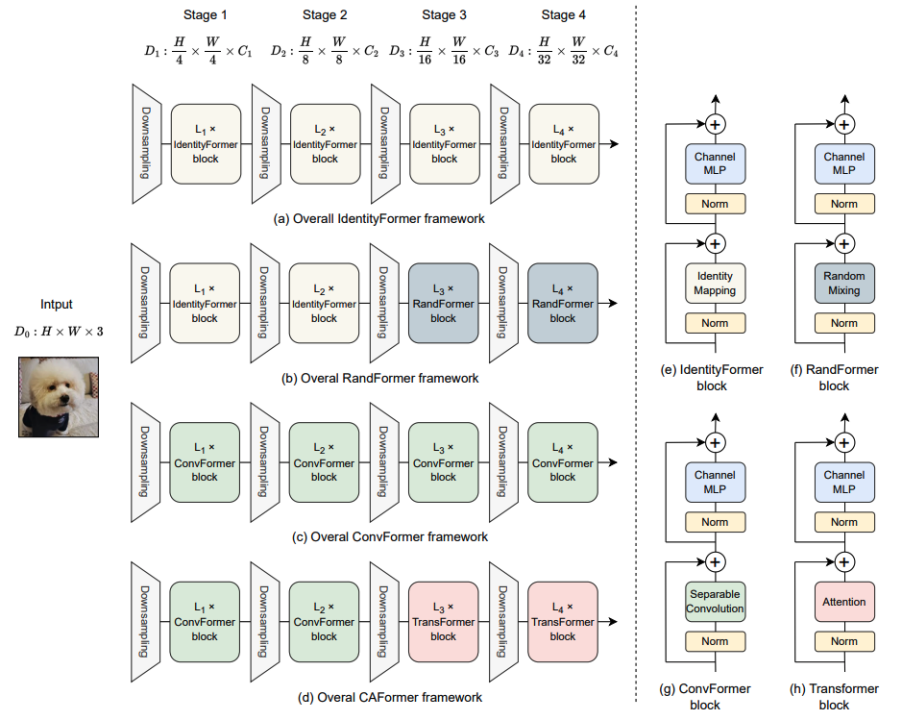

图 2:(a-d)IdentityFormer、RandFormer、ConvFormer 和 CAFormer 的总体框架。与 ResNet 类似,模型采用四阶段架构,阶段 i 具有特征维度为 Di 的 Li 个 block。每个下采样模块由一层卷积实现。第一个下采样的 kernel 大小为 7,stride 为 4,而后三个下采样的 kernel 大小为 3,stride 为 2。(e-h) IdentityFormer、RandForemr、ConvFormer 和 Transformer block 的架构,它们的 token mixer 分别为恒等映射,随机混合,可分离卷积和原始 self-attention。

3.MetaFormer 轻松地提供 SOTA 性能。无需设计新的 token mixer,仅需装备五年前的 “老式” 算子,所衍生的 MetaFormer 具体模型就实现了 SOTA。

ConvFormer 大幅优于 ConvNeXt。通过简单地将 token mixer 设定为可分离卷积,所衍生的纯卷积模型 ConvFormer 性能大幅优于 ConvNeXt。

CAFormer 刷新 ImageNet 记录。通过将四阶段模型的前两个阶段的 token mixer 设置为可分离卷积,后两个阶段设置为原始的 self-attention,所衍生模型 CAFormer 在 ImageNet 无额外数据常规有监督训练下,在 224x224 分辨率上创造 85.5% 准确率的新纪录。

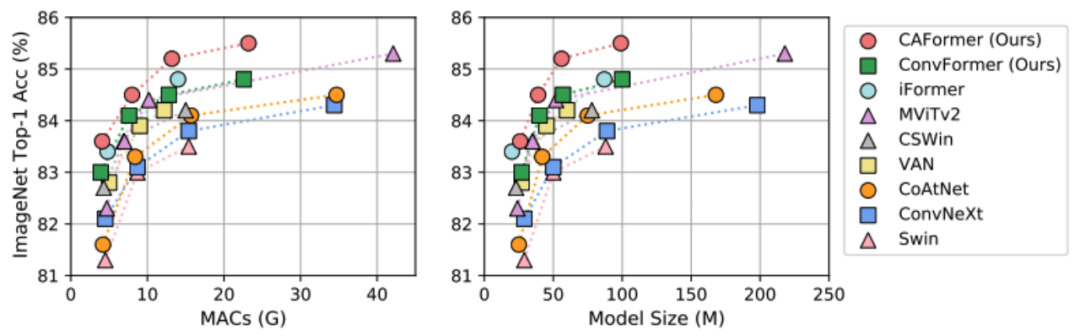

图 3:各种先进模型(图中 Swin 都成了垫底)在 ImageNet 224x224 上准确率、计算量和模型规模的比较。□、△和○分别代表 CNN 类,attention 类和混合类模型。在各个维度的计算量和模型规模下,ConvFormer 均优于同类 CNN 模型;CAFormer 明显优于其他各类模型。值得注意的是 CAFormer 取得新的准确率记录 85.5%,不仅超过之前 MViTv2 取得的 85.3% 的记录,还比 MViTv2 减少了 55% 的参数量和 45% 的计算量。

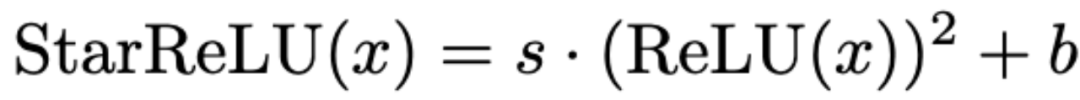

4. 新型激活函数 StarReLU 超越 GELU。此外,作者还提出了新型激活函数 StarReLU 用以取代常用的 GELU 激活函数。该函数为平方 ReLU 的变体,为消除分布偏移而设计。StarReLU 每个神经元仅需 4 FLOPs,相比 GELU (14 FLOPs)减少了 71% 的计算量,却取得更好的性能。ConvFormer-S18 模型在 ImageNet 数据集上,使用 StarReLU 相比 GELU 准确率提升 0.3%,相比 ReLU 提升了 0.9%。

其中 s 和 b 为所有通道共享的标量,可设为固定值或者可学参数。

以上作者通过将 token mixer 设置为最基本或者最常见的算子(恒等映射、随机混合、可分离卷积和原始 self-attenton)来进一步探索 MetaFormer 架构的下限、通用性和潜力。所提各种 MetaFormer 模型可作为视觉领域可靠的基线。相信当引入更先进 token mixer 或者训练策略时,MetaFormer 类模型会打破记录,取得新的 SOTA。