来源: 神经现实

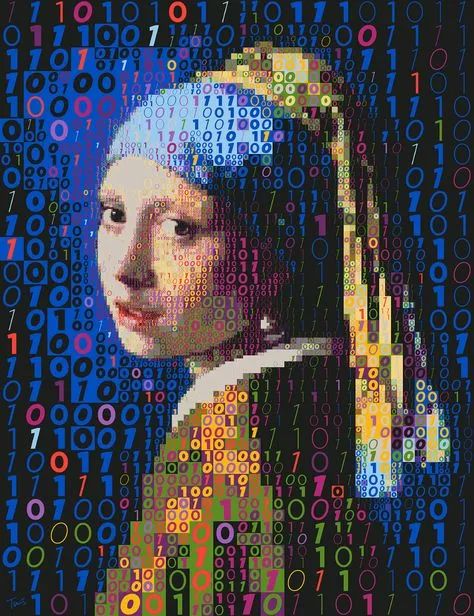

随着女性机器人(如索菲娅)的增多和女性虚拟助手(如苹果的Siri、亚马逊的Alexa和微软的Cortana)的流行,人工智能似乎面临着性别问题。

人工智能的性别失衡是一种普遍趋势,在媒体上引发了尖锐的批评,甚至联合国教科文组织也对这种做法的危险性提出了警告,因为它会强化物化女性的刻板印象。

人工智能是如何与女性特质捆绑在一块的?要想阻止女性人工智能的大量出现,我们需要更好地理解这种现象的根源。

让非人类更加人性化

在发表于期刊《心理学与营销学》(Psychology & Marketing)的一篇文章*中,我们主张,厘清人何以为人,能够为我们理解人工智能系统性的女性化提供新的视角。我们认为,人工智能领域更倾向于物化女性,这不仅仅是因为她们被视为最佳的助手,也是因为人们将更多的人性赋予了女性(而不是男性)。

-Vin Basilio-

为什么?因为女性被认为比男性更加温暖、更容易体会到情绪,人工智能的女性化有助于让人工智能更具人性。温暖和情绪体验(而非能力)的确被视为成为一个完整的人的基本特性,而机器缺乏这些特性。

根据去人性化和物化的理论,我们通过5项研究、总计3000余人的样本表明:

在总体上,与男性及非人类(动物和机器)*相比,人们认为女性更加人性化。

女性机器人比男性机器人被赋予更加积极的人类特性,相比于动物和机器,她们也被认为比男性机器人更加人性化。

在医疗健康领域,女性机器人的“人性”让人感到接受的治疗更加特殊,使得人们对人工智能疗法更加赞同。

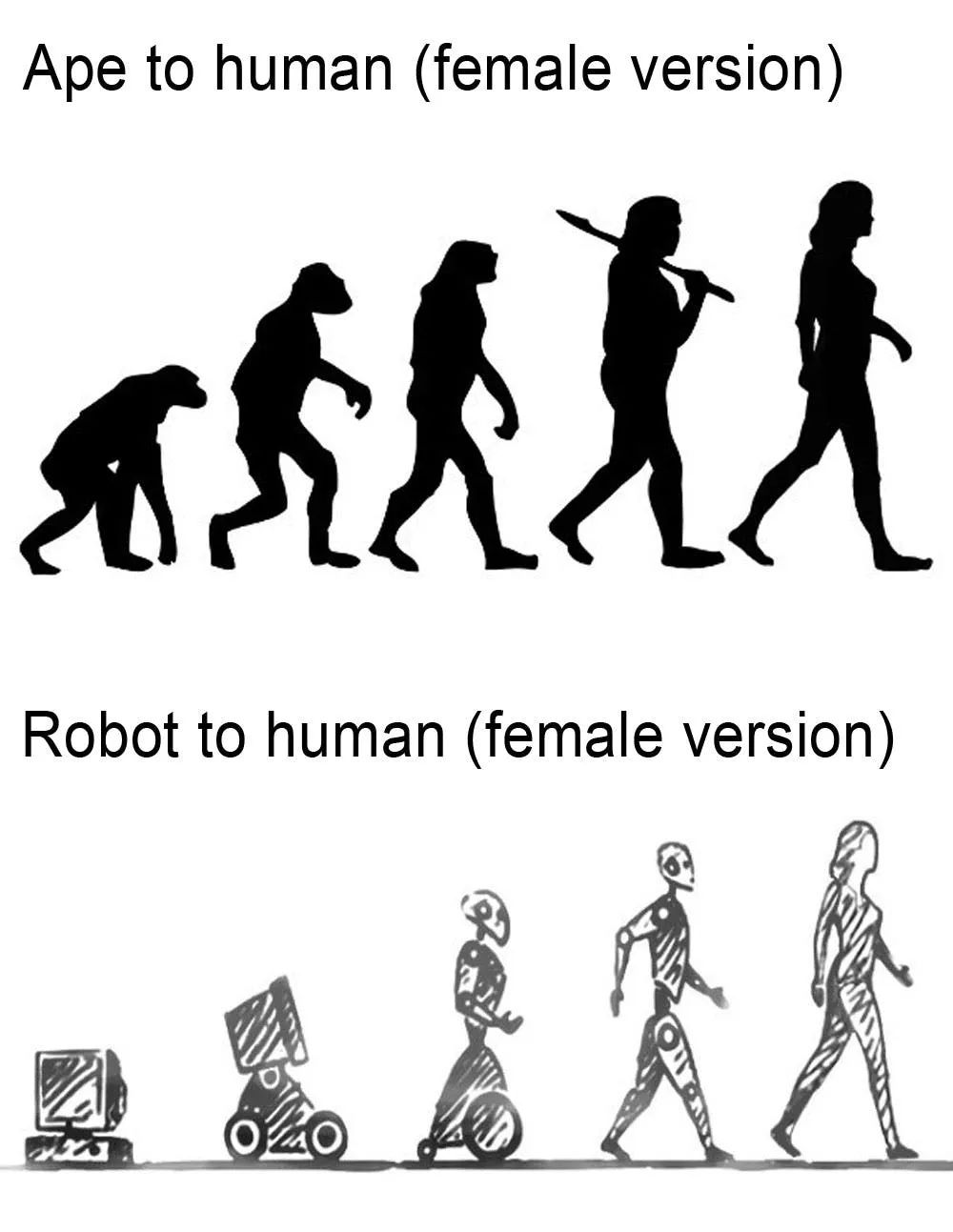

我们使用多个不同的方法来测量机器人相比于动物和机器的人性化程度。例如,为了测量与动物相比女性和男性机器人外显的人性化程度,我们使用了基于经典的“前进的进程”(march of progress)图示*的上升人性化量表(the ascent humanization scale)。我们明确地要求网络参与者通过古猿到现代人类的连续演化过程,来表现他们认为女性或男性机器人处于演化进程的什么阶段。

*该图示展现了人类2500万年的演化史,一共包含15个人类祖先的行走侧影。

—

Sylvie Borau

为了测量女性和男性机器人相对于机器的人性化程度,我们设计了一份量表,将人类的演化描绘为从机器人到人类(而不是猿到人类),用于测量外显的机器性(去)人性化程度。当然,我们针对女性和男性设计了两种版本的量表。

其他测量针对的是对人性化程度更加细微和内隐的感知:我们向参与者询问,他们认为男性和女性机器人具有什么样的情绪水平。一些情绪据称能区分人类与机器(如“友善”、“风趣”),其他的情绪能够区分人类与动物(即“有组织的”、“礼貌的”)。最后,我们也使用了内隐联结测验,探究女性机器人是否比男性机器人更有可能与“人类”而非“机器”的概念相连。

机器中的幽灵

在大多数细微量表以及所有外显和内隐人性化量表上,女性和女性机器人都被认为更加人性化。除此之外,我们还发现男性和男性机器人在细微人性化量表的消极维度上被认为更加人性化。总的来说,这些结果表明,相较于男性机器人,女性机器人不仅被赋予了更加积极的人类特性(善意性别偏见),她们也被认为更加人性化,人们期待女性机器人在服务中更倾向于考虑被服务对象的独特需求。

这些发现可能为人们更偏好女性机器人提供了新的解释——人们更喜欢女性智能机器是因为它们与人性有更强的关联。

-MarcosChin-

如果女性气质被用于使非人类实体人性化,那么这项研究表明,在人工智能中将女性视为物体可能恰恰由于人类意识到女性不是物体。尽管流行的假设(通常被称为去人性化假设)认为,在物化群体外成员之前必须将他们视为动物或工具。换句话说,去人性化是物化发生的前提,被物化的目标通常被否认具有人性。与这一主流观点相反,人工智能的女性化或许不是因为人们认为女性低于人类,而是因为,女性从一开始就被视为是超人类的。

这与玛莎·努斯鲍姆(Martha C。 Nussbaum)的主张相符:“物化意味着将某物变成一件东西……一个不存在的东西”。它也与凯特·曼恩(Kate Manne)对于厌女症和去人性化的观点相合:“通常,人们缺乏的不是对女性人性程度的认识,女性(过度)的人性才是问题所在”。因此,人工智能中广泛使用女性身份可能扎根于某种内隐认识,即女性被认为更加人性化,比男性更甚。

现实世界对于女性的物化

这项研究想要通过比较是什么使人类比机器更具人性,来理解人工智能中普遍存在的女性化现象的深层根源。因为情感是我们人性的本质,也因为人们普遍认为女性更容易体验到情感,我们认为人工智能女性化能让它们看起来更像人类、更有可能考虑我们的独特需求。然而,机器人的女性化进程可能传达出女性是物体、是被用来满足主人需求的简单工具的观点。这可能会加剧现实世界中女性的物化和去人性化。

-Charis Tsevis-

因此,这项研究突出了人工智能设计者和政策制定者面临的道德窘境:人工智能的女性化是对女性的物化,但将女性的人性注入到人工智能中,会让这些机器看起来更加人性化、更容易被接受。

无论是对于人工智能性别平等的未来,还是终结人工智能中的女性物化而言,这样的结果并不是特别令人鼓舞。开发不分性别的声音可能是消除人工智能女性化,停止这种善意性别歧视的一种方式。我们还可以参考谷歌最近的实验,强加一个默认的性别语音,随机、等概率地将一个男性或女性智能机器人分配给用户。

作者:Sylvie Borau" 封面:Vin Basilio